Au-delà de V3-V4 : Stratégies pour atténuer le biais de primer et les effets de lot pour des données microbiomes fiables

Le basecalling moderne par nanopore n'est plus une étape légère après course qui peut être assignée à n'importe quel poste de travail disponible. Dans l'actuelle pile logicielle ONT, Dorado est le basecaller par défaut intégré dans MinKNOW, les familles de modèles actuelles sont explicitement organisées autour des compromis entre rapidité, hac et sup, et la documentation des flux de travail considère désormais le basecalling comme faisant partie d'une chaîne de traitement plus large plutôt que comme une étape de conversion autonome. Pour les équipes responsables de la révision de la qualité des données et de la compatibilité des pipelines, cela déplace la véritable question de "Pouvons-nous effectuer le basecalling ?" à "Pouvons-nous le faire avec un délai de réponse prévisible, des sorties compatibles et un coût opérationnel acceptable ?"

Cet article traite de la sélection d'infrastructure, du débit, de la gestion des données, de l'emballage des résultats et des normes de révision opérationnelle pour les flux de travail de basecalling par nanopore. Il n'aborde pas les tests cliniques, l'utilisation par les patients, la prise de décision diagnostique, la sélection des traitements ou la validation médicale réglementée. Toute référence à la qualité des résultats, au délai de traitement ou à la compatibilité en aval concerne strictement la performance technique des flux de travail et la préparation à la livraison des fichiers dans des environnements de recherche. Les équipes doivent définir leurs propres critères d'acceptation internes pour le traitement des données de recherche, y compris les exigences en matière de provenance, de reproductibilité et de format de transfert, avant d'adopter une exécution locale, dans le cloud ou gérée.

Aperçu des décisions rapides

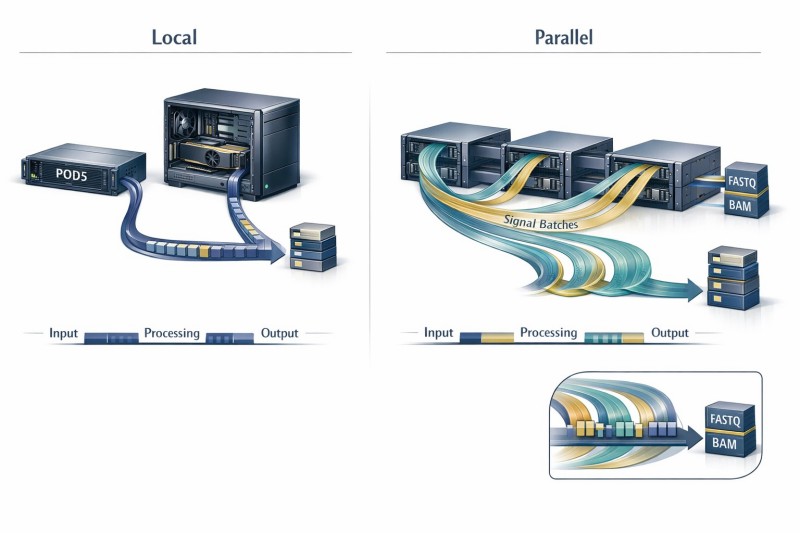

L'exécution locale sur GPU est souvent suffisante lorsque le volume de données est faible, que la concurrence est limitée et que l'équipe peut tolérer un certain temps d'attente et la maintenance de l'environnement. L'exécution élastique ou gérée devient plus attrayante lorsque le débit mensuel est irrégulier, que plusieurs projets se disputent le même matériel, ou que les équipes en aval ont besoin d'une livraison standardisée de fichiers FASTQ ou BAM avec une provenance claire et un minimum de transfert manuel. En pratique, la décision ne concerne que rarement la possibilité d'exécuter le basecalling. Il s'agit de savoir s'il peut être exécuté avec un délai de réponse acceptable, un emballage de sortie stable et un faible impact opérationnel.

La demande de calcul haute performance pour le basecalling moderne

Selon la documentation actuelle de Dorado, chaque génération de modèle comprend généralement des variantes fast, hac et sup. Celles-ci sont classées par ordre croissant de précision, les modèles plus grands étant généralement plus coûteux en termes de calcul à évaluer ; ONT note également que hac est le point d'équilibre recommandé pour la plupart des utilisateurs. C'est un signal opérationnel important pour la planification des infrastructures : le choix du modèle n'est pas seulement un choix de qualité, mais aussi un choix de planification de capacité.

Dans la documentation de wf-basecalling d'ONT, le basecalling Dorado nécessite un GPU NVIDIA avec une architecture Pascal ou plus récente et au moins 8 Go de vRAM. La même documentation de flux de travail précise également que le flux de travail peut accepter des entrées de signal FAST5 ou POD5 et émettre des fichiers FASTQ, CRAM ou BAM non alignés, avec des fichiers BAM ou CRAM triés et indexés possibles lorsqu'une référence est fournie. Cela signifie que les décisions concernant l'infrastructure de basecalling affectent non seulement la vitesse d'inférence, mais aussi la rapidité avec laquelle un projet peut atteindre un état de transfert prêt pour l'étape suivante.

POD5 ajoute une autre couche à cette image de calcul. Dans la documentation et la spécification de POD5 d'ONT, POD5 est décrit comme un format de lecture brute en streaming stocké à l'aide de structures basées sur Apache Arrow / Feather. Cela est important car la vitesse de basecalling n'est pas déterminée uniquement par le débit du GPU. Le GPU doit être alimenté efficacement, et les goulets d'étranglement de stockage ou de réseau peuvent laisser le calcul disponible sous-utilisé. Pour l'examen opérationnel, cela signifie que la disposition des données brutes, les performances NVMe locales, le comportement du système de fichiers partagé et la stratégie de mise en scène peuvent tous affecter le débit réel.

Pour un évaluateur en bioinformatique, les questions pratiques sont donc plus spécifiques que "L'équipe a-t-elle utilisé Dorado ?" Un cadre d'audit plus solide comprend :

- Quel niveau de modèle a été utilisé, et pourquoi ?

- Le signal brut a-t-il été ingéré à partir de POD5 ou de FAST5 hérité ?

- L'environnement d'exécution avait-il suffisamment de mémoire GPU libre pour un dimensionnement de lot stable ?

- Les résultats ont-ils été livrés dans le format attendu par le flux de travail en aval ?

- Les rediffusions ou ralentissements étaient-ils causés par des problèmes de mise en file d'attente, de stockage ou d'environnement plutôt que par le modèle lui-même ?

Une configuration qui produit finalement des lectures n'est pas automatiquement adaptée à une livraison à l'échelle du projet.

Figure 1. Le débit de basecalling dépend du comportement combiné de la vitesse d'ingestion de POD5, de la capacité d'inférence du GPU, de la marge de VRAM disponible et des étapes de génération de sortie telles que l'émission BAM ou l'enchaînement en aval.

Figure 1. Le débit de basecalling dépend du comportement combiné de la vitesse d'ingestion de POD5, de la capacité d'inférence du GPU, de la marge de VRAM disponible et des étapes de génération de sortie telles que l'émission BAM ou l'enchaînement en aval.

Une vue pratique de la sélection de modèles

Pour la plupart des équipes, fast, hac et sup devraient être considérés comme des modes de fonctionnement plutôt que comme des étiquettes :

| Niveau de modèle | Cas d'utilisation pratique | Force | Principale compromis |

|---|---|---|---|

| Rapide | Courses exploratoires rapides, contrôle qualité précoce, aperçus à faible latence | Débit maximal | Plafond de précision inférieur |

| HAC | Appel de base de production général | Qualité équilibrée et coût de calcul | A besoin d'une capacité GPU significative. |

| SUP | Flux de travail axés sur la précision | Niveau de précision le plus élevé | Demande de calcul la plus élevée et délais plus longs |

Ce cadre suit les recommandations actuelles du modèle d'ONT : les modèles plus grands coûtent plus cher à évaluer, et le hac est généralement recommandé comme le meilleur compromis pour la plupart des utilisateurs.

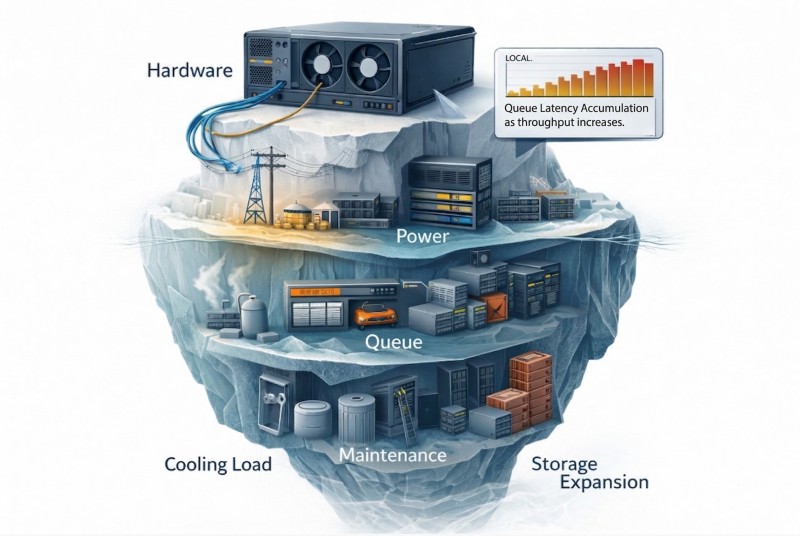

Serveurs GPU locaux : La dette technique cachée

Un serveur GPU local semble souvent économique car le coût visible est facile à quantifier : achat de matériel, un effort de configuration unique et un sentiment de propriété directe. Le fardeau moins visible apparaît plus tard. Dorado continue d'évoluer, et la page de version actuelle d'ONT montre un historique de versions actif avec des mises à jour de fonctionnalités et des changements de comportement en cours. L'amélioration rapide du logiciel est précieuse, mais cela signifie également que les environnements locaux nécessitent un entretien soutenu si les équipes souhaitent éviter un écart entre l'exécution, les pilotes, les conteneurs et les attentes de flux de travail.

Le deuxième coût caché est la latence de la file d'attente. Un nœud local qui fonctionne bien pour un traitement occasionnel peut devenir le goulot d'étranglement au moment où plusieurs projets soumettent des tâches en même temps. Dans cette situation, le temps de réponse effectif n'est plus seulement le temps d'exécution. Il devient le temps d'attente, le temps d'exécution, le temps de nouvelle tentative et le temps de post-traitement. Pour un responsable en bioinformatique, cela a de l'importance car la révision en aval ne commence pas lorsque le calcul commence ; elle commence lorsque les fichiers sont livrés dans un état utilisable.

Le troisième coût caché est la fragilité des piles. Des systèmes de flux de travail tels que Nextflow existent pour rendre les pipelines computationnels reproductibles dans des environnements locaux, HPC et cloud, tandis que le cadre nf-core a été conçu pour soutenir des pipelines portables, curés par la communauté, avec la reproductibilité et la normalisation à l'esprit. Si un environnement local ne peut pas suivre ce modèle de portabilité, l'équipe peut conserver la propriété du matériel mais perdre la stabilité du flux de travail.

Idée reçue : "Une station de travail puissante suffit"

Cette hypothèse ne tient que lorsque le débit est modeste, la concurrence est limitée et les exigences de délai sont flexibles. Elle devient risquée lorsqu'une équipe gère plusieurs projets actifs, utilise régulièrement des niveaux de modèle plus coûteux ou essaie d'emballer les résultats pour un transfert standardisé en aval.

Une meilleure question n'est pas de savoir si la station de travail peut effectuer un seul cycle, mais si elle peut le faire de manière répétée, sous charge, avec suffisamment de cohérence pour soutenir l'examen du projet.

Résolution des signes de dette technique locale

| Symptôme | Cause probable | Effet opérationnel | Action corrective |

|---|---|---|---|

| L'utilisation du GPU reste faible pendant que les tâches s'exécutent pendant longtemps. | Goulot d'étranglement de stockage ou d'E/S, mauvaise mise en scène, taille de lot conservatrice | Débit faible malgré un matériel coûteux | Auditer le chemin d'accès POD5, la mise en scène et les performances de stockage. |

| Le temps d'exécution varie fortement entre des projets similaires. | Mise en file d'attente sur un nœud partagé | Incohérence de livraison | Séparer le temps d'attente de traitement dans les rapports d'examen. |

| Les échecs apparaissent après les mises à jour. | Incompatibilité entre le pilote, CUDA ou le conteneur | Rediffusions et temps d'arrêt | Verrouiller les versions des environnements et tester avant la production |

| Les fichiers arrivent, mais le traitement en aval est bloqué. | L'emballage de sortie ne correspond pas au point d'entrée du flux de travail. | Retravail manuel | Définir les formats de transfert et les métadonnées à l'avance. |

Figure 2. Le coût opérationnel du basecalling local sur GPU inclut non seulement l'acquisition du matériel, mais aussi le refroidissement, la maintenance logicielle, la gestion des files d'attente et le risque de réexécution.

Figure 2. Le coût opérationnel du basecalling local sur GPU inclut non seulement l'acquisition du matériel, mais aussi le refroidissement, la maintenance logicielle, la gestion des files d'attente et le risque de réexécution.

Cloud vs. Informatique Gérée : Efficacité et Scalabilité

L'avantage principal de l'exécution dans le cloud ou gérée n'est pas seulement l'accès à distance aux GPU. C'est la capacité de séparer les flux de travail scientifiques de la propriété matérielle.

Nextflow prend en charge l'exécution sur des systèmes locaux, des planificateurs HPC et des back-ends orientés cloud, et le cadre nf-core formalise l'emballage de pipelines reproductibles pour les flux de travail en bioinformatique. En termes pratiques, cela signifie que l'appel de base Nanopore peut désormais être considéré comme une charge de travail portable plutôt que comme une tâche liée à une machine. Une fois qu'un flux de travail est portable, la question limitante passe de "Quel poste de travail avons-nous ?" à "Quel modèle d'exécution offre le meilleur délai, la meilleure reproductibilité et le meilleur standard de livraison ?"

L'exécution gérée aide également lorsque le débit devient inégal. Un serveur local est généralement conçu autour d'un cas moyen, mais les projets de séquençage réels arrivent souvent par vagues. L'exécution élastique permet aux équipes de gérer la demande de pointe sans dimensionner le matériel local autour de pics rares. Cela crée également un meilleur chemin pour enchaîner le basecalling dans des flux de travail standardisés de lecture longue, tels que Séquençage ciblé par nanopore ou Séquençage ultra-long par nanopore, où le calcul, l'emballage des fichiers et les attentes en aval doivent être alignés dès le départ.

Une couche de calcul gérée devient particulièrement attrayante lorsque le besoin réel n'est pas "le temps GPU" de manière abstraite, mais l'emballage de sortie conscient du flux de travail. Dans la documentation actuelle du flux de travail d'ONT, le basecalling peut alimenter directement des sorties alignées ou non alignées en fonction de la configuration. Cela est beaucoup plus proche de la manière dont les examinateurs techniques expérimentent réellement la qualité de livraison : non pas comme un score de référence, mais comme une question de savoir si les fichiers reçus sont prêts pour l'étape suivante sans nettoyage manuel.

Matrice de Décision Stratégique : Quand Externaliser Votre Informatique ?

Une décision d'externalisation pratique devrait être basée sur la forme de la charge de travail, la concurrence, la capacité d'ingénierie interne et la rigueur de la norme de livraison.

| Situation | Un GPU local est généralement suffisant. | L'exécution gérée ou élastique est généralement plus forte. |

|---|---|---|

| Faible débit mensuel stable | Oui | Généralement inutile |

| Débit mensuel par pics | Parfois | Souvent oui |

| Plusieurs groupes partageant un même nœud | Risqué | En général, oui. |

| L'équipe peut maintenir la pile d'exécution en toute confiance. | Possiblement | Dépend du coût d'opportunité. |

| Le transfert standardisé en aval est essentiel. | Souvent difficile | En général, oui. |

| Modèles de gamme supérieure utilisés régulièrement | Souvent contraint | En général, oui. |

La variable cachée est le temps des personnes. Lorsque le personnel expérimenté en bioinformatique consacre des efforts à déboguer des problèmes d'exécution au lieu de revoir les résultats, d'optimiser les analyses ou de standardiser les livraisons, l'équipe paie une taxe d'infrastructure qui apparaît rarement dans les tableaux de procurement.

Établir des questions d'audit à poser avant le début d'un projet.

- Quelle est l'intensité attendue de l'entrée de données brutes mensuelles ?

- Quel temps d'attente est acceptable avant le début du basecalling ?

- Quels artefacts de sortie sont requis : FASTQ, BAM non aligné, BAM aligné, CRAM ou plusieurs formes ?

- Quel niveau de modèle Dorado sera utilisé pour la livraison de production ?

- Les étapes du flux de travail en aval commenceront-elles automatiquement ou par transfert manuel ?

- Qui est responsable de la maintenance de l'environnement et des relances lorsque les dépendances logicielles changent ?

Lorsque les réponses sont incertaines, le problème est généralement plus vaste que le choix du matériel. C'est une question de gouvernance des flux de travail.

Pour un transfert spécifique au flux de travail, le support d'emballage de longues lectures associé peut être plus important que l'accès à des ressources de calcul génériques. C'est pourquoi certaines équipes recherchent des portées de service qui s'alignent déjà sur les attentes de sortie au niveau des tests, telles que Séquençage de Transcriptions Complètes (Iso-Seq) ou Analyse de Longs Amplicons (LAA)plutôt que de traiter le basecalling comme une étape technique isolée.

Normes de livraison technique pour le transfert FASTQ/BAM

L'acceptation de la basecalling externalisée doit être définie comme une norme de livraison technique couvrant la compatibilité des formats, la provenance et l'auditabilité.

Un paquet de livraison robuste doit clairement spécifier :

- type d'entrée brut reçu

- basecaller et version

- niveau de modèle utilisé

- si le basecalling modifié était activé

- types de fichiers de sortie livrés

- métriques de résumé et notes de fonctionnement

- sommes de contrôle d'intégrité

- toutes rediffusions, exclusions ou exceptions d'emballage

Cette norme est plus utile qu'une discussion vague sur la "qualité", car elle définit ce que l'équipe réceptrice peut réellement vérifier.

La compatibilité des formats de fichier est plus importante que la complétude générique.

FASTQ reste le transfert générique le plus sûr pour de nombreux flux de travail personnalisés en aval. Le BAM non aligné peut être précieux lorsque l'emballage riche en métadonnées est préféré. Le BAM ou CRAM aligné est utile lorsque le périmètre du service inclut explicitement l'alignement par rapport à une référence définie et que l'équipe réceptrice s'attend à des sorties mappées.

Là où le flux de travail plus large s'étend à la caractérisation de séquences en aval, la norme d'emballage la plus utile est généralement définie par le point d'entrée de l'analyse, les métadonnées attendues et le format de transfert plutôt que par le calcul seul. C'est pourquoi certaines équipes alignent la livraison de la basecalling avec les flux de travail qu'elles utilisent déjà pour Séquençage de région ciblée ou Services de séquençage d'amplicons, où la structure des fichiers et les attentes en matière de métadonnées sont déjà bien définies.

Une liste de contrôle d'audit des fournisseurs compacte

Avant d'accepter un modèle de livraison, demandez si le fournisseur peut documenter :

| Question d'audit | Pourquoi c'est important |

|---|---|

| La version du basecaller est-elle enregistrée ? | Soutient la reproductibilité et le dépannage |

| Le niveau du modèle est-il documenté ? | Explique les compromis entre le débit et la qualité. |

| Les formats de sortie sont-ils prédéfinis ? | Réduit la friction en aval. |

| Les fichiers journaux et les fichiers de résumé sont-ils inclus ? | Améliore l'auditabilité |

| Des sommes de contrôle sont-elles fournies ? | Confirme l'intégrité du transfert |

| Les rediffusions sont-elles documentées ? | Aide à expliquer la variance inattendue. |

QC et dépannage : Que vérifier lorsque le débit ou la production semble incorrect ?

Le débit est inférieur à ce qui était attendu.

Vérifiez d'abord si le goulot d'étranglement est vraiment lié au calcul. Selon la documentation actuelle de POD5, le format est diffusé et conçu pour un traitement brut accessible, mais cela n'élimine pas les goulots d'étranglement de stockage. Des disques locaux lents, une congestion réseau partagée ou un staging faible peuvent tous réduire le débit effectif même lorsque la capacité GPU est disponible.

Le délai de réalisation est incohérent entre des projets similaires.

C'est souvent un problème de planification plutôt qu'un problème de basecalling. Séparez le temps d'attente du temps d'exécution dans les rapports. Sans cette distinction, les équipes ne peuvent pas déterminer si le problème est lié au coût du modèle, à la capacité de l'infrastructure ou à la contention de la charge de travail.

Les lectures livrées semblent différentes d'un lot précédent.

Vérifiez si le même niveau de modèle, la même version d'exécution et le même mode de sortie ont été utilisés. La documentation actuelle de Dorado distingue explicitement les modèles fast, hac et sup par leur précision et leur coût de calcul, donc les variations de sortie peuvent refléter des choix opérationnels plutôt qu'une instabilité aléatoire.

Les fichiers BAM sont plus difficiles à utiliser que prévu.

Confirmez si les fichiers sont alignés ou non alignés et si l'emballage correspond au point d'entrée du flux de travail en aval. Dans la documentation de basecalling wf d'ONT, le flux de travail peut produire des fichiers FASTQ, CRAM ou BAM non alignés, avec des sorties mappées triées et indexées lorsque l'alignement guidé par référence est inclus. Ces distinctions doivent être définies avant la livraison, et non déduites par la suite.

Signaux d'externalisation : Quand garder cela en interne cesse d'être efficace

L'exécution gérée devient plus attrayante lorsque l'emballage informatique, le temps de réponse et le transfert en aval doivent être standardisés ensemble plutôt qu'optimisés séparément.

Cela se produit généralement lorsque plusieurs pressions apparaissent en même temps : l'arrivée de données brutes par à-coups, la concurrence pour le matériel partagé, la maintenance répétée de l'environnement et la demande croissante de normes de livraison de fichiers cohérentes. Dans ce contexte, l'unité économique n'est plus le GPU lui-même. C'est l'ensemble du flux de travail, de l'ingestion du signal à la sortie conditionnée.

Pour certaines équipes, ce changement est plus facile à gérer lorsque le contexte de calcul et d'analyse est regroupé dans des catégories de services telles que Séquençage du génome viral ou Séquençage du génome complet microbien, où le traitement des longues lectures, les attentes de livraison et la révision des séquences en aval peuvent être standardisés ensemble.

Conclusion : Accélérer la recherche en dissociant la science de l'infrastructure

Dans les environnements RUO, un accès plus rapide à des sorties FASTQ ou BAM fiables signifie une révision en aval plus précoce, un dépannage plus rapide et des décisions de projet plus tôt. La pile actuelle d'ONT reflète déjà ce changement : Dorado est le basecaller par défaut intégré à MinKNOW, les familles de modèles actuelles sont documentées de manière ouverte autour des compromis entre calcul et précision, et la documentation officielle des flux de travail considère le basecalling comme une partie configurable d'une chaîne de sortie plus large. Les équipes qui évaluent encore le basecalling comme une simple tâche de poste de travail sous-estiment probablement à la fois les exigences en matière de calcul et les exigences de livraison.

La décision la plus utile n'est donc pas "local contre cloud" dans l'abstrait. Il s'agit de savoir si l'infrastructure actuelle peut convertir des signaux bruts en sorties standardisées et compatibles en aval avec un délai acceptable et sans consommer un travail scientifique disproportionné. Lorsque la réponse est non, l'exécution gérée ou externalisée n'est pas simplement une commodité. C'est une étape d'optimisation des flux de travail.

Figure 3. Le traitement parallèle géré ou basé sur une plateforme peut réduire l'arriéré et améliorer la cohérence de la livraison en convertissant les entrées POD5 en sorties FASTQ/BAM standardisées selon des règles de flux de travail partagées.

Figure 3. Le traitement parallèle géré ou basé sur une plateforme peut réduire l'arriéré et améliorer la cohérence de la livraison en convertissant les entrées POD5 en sorties FASTQ/BAM standardisées selon des règles de flux de travail partagées.

FAQ

1. L'accélération GPU est-elle optionnelle pour le basecalling moderne de Nanopore ?

Pas dans la plupart des environnements sensibles à la performance. La documentation actuelle du flux de travail d'ONT nécessite un GPU NVIDIA avec une architecture Pascal ou plus récente et au moins 8 Go de vRAM pour le basecalling wf basé sur Dorado.

2. Quel niveau de modèle est le plus pratique par défaut ?

Pour de nombreux flux de production, le hac est l'équilibre le plus pratique car l'ONT le recommande comme le meilleur compromis entre précision et coût computationnel pour la plupart des utilisateurs.

3. Pourquoi le POD5 est-il important pour la planification des infrastructures ?

Parce que POD5 est diffusé en continu et basé sur des structures Apache Arrow, ce qui fait de l'accès aux données brutes et de la mise en scène une partie de l'équation de débit plutôt qu'une réflexion après coup.

4. Quand un serveur GPU local est-il encore suffisant ?

En général, lorsque le volume de données est faible, la concurrence est limitée et l'équipe peut tolérer un certain temps d'attente et la maintenance de l'environnement.

5. Que devrait inclure chaque livraison externalisée ?

Au minimum : format d'entrée, version du basecaller, niveau de modèle, type de sortie, métriques de résumé et sommes de contrôle d'intégrité.

6. Devrais-je demander des fichiers FASTQ ou BAM ?

Demandez le format qui correspond à votre point d'entrée dans le flux de travail en aval. FASTQ est le transfert générique le plus sûr ; BAM est utile lorsque la gestion des métadonnées ou les sorties mappées font déjà partie du plan de flux de travail.

7. L'exécution gérée est-elle toujours supérieure à l'infrastructure locale ?

Non. Les charges de travail stables et à faible volume peuvent toujours bien s'adapter à l'infrastructure locale. L'exécution gérée devient plus attrayante lorsque la charge de pointe, la mise en file d'attente et la standardisation sont plus importantes.

8. Quel est le signal le plus clair que l'externalisation est justifiée ?

Lorsque l'équipe passe plus de temps à maintenir l'environnement d'exécution qu'à examiner ou à utiliser les données.

Références évaluées par des pairs

- Di Tommaso P, Chatzou M, Floden EW, Prieto Barja P, Palumbo E, Notredame C. Analyse complète de référence et architecturale des modèles d'apprentissage profond pour le basecalling de séquençage par nanopores. Nature Biotechnology. 2017;35(4):316-319. 10.1038/nbt.3820

- Wick RR, Judd LM, Holt KE. Performance des outils de basecalling par réseau de neurones pour le séquençage Oxford Nanopore. Genome Biology. 2019;20:129. 10.1186/s13059-019-1727-y

- Pagès-Gallego M, de Ridder J. Analyse complète des références et des architectures des modèles d'apprentissage profond pour le basecalling de séquençage par nanopore. Genome Biology. 2023;24:71. 10.1186/s13059-023-02903-2

- Ewels PA, Peltzer A, Fillinger S, Patel H, Alneberg J, Wilm A, Garcia MU, Di Tommaso P, Nahnsen S. Le cadre nf-core pour les pipelines de bioinformatique curés par la communauté. Nature Biotechnology. 2020;38:276-278. 10.1038/s41587-020-0439-x

- Abel NB, de Lannoy C, Loose M, Leggett RM. Pod5Viewer : une interface graphique pour inspecter les données de séquençage nanopore brutes. Bioinformatique. 2024. 10.1093/bioinformatics/btae665

Services connexes

Directives de Soumission d'Échantillons

Directives de Soumission d'Échantillons